OpenAI apresenta arquitetura inédita para acelerar modelos de IA

Tempo de Leitura – 8 minutos

A expressão “OpenAI apresenta arquitetura inédita para acelerar modelos de IA” representa um dos assuntos mais relevantes do cenário tecnológico contemporâneo. Durante o episódio 18 do podcast oficial da OpenAI, o apresentador Andrew Mayne conversou com Mark Handley e Greg Steinbrecher sobre uma inovação capaz de transformar o treinamento de sistemas inteligentes em escala global. O debate revelou que o avanço da computação cognitiva depende não apenas de chips velozes, mas também da eficiência das conexões internas entre milhares de aceleradores computacionais espalhados por enormes centros de processamento. Segundo os convidados, a evolução da inteligência artificial agora depende diretamente da qualidade das redes que conectam esses equipamentos.

Além disso, os especialistas explicaram que os data centers modernos enfrentam desafios completamente diferentes daqueles existentes na antiga era da internet tradicional. Antes, servidores atendiam milhões de usuários realizando atividades independentes, como acessar páginas, enviar mensagens ou assistir vídeos. Atualmente, enormes conjuntos de processadores precisam operar sincronizados em uma única tarefa matemática extremamente complexa. Como consequência, qualquer atraso mínimo em apenas um equipamento pode comprometer o desempenho de toda a estrutura computacional, gerando desperdício de tempo, energia elétrica e capacidade operacional.

Por outro lado, a OpenAI afirma que sua nova solução denominada MRC, sigla para Multipath Reliable Connection, removeu um dos maiores obstáculos para ampliar a escala dos treinamentos inteligentes. A tecnologia foi desenvolvida para evitar congestionamentos internos e permitir que milhares de GPUs trabalhem simultaneamente sem perdas significativas de desempenho. Dessa maneira, a empresa acredita que conseguirá acelerar a criação de modelos mais sofisticados e disponibilizar ferramentas ainda mais avançadas para usuários do mundo inteiro.

Tabela de conteúdos

O crescimento explosivo dos sistemas inteligentes

Inicialmente, Greg Steinbrecher relatou sua trajetória acadêmica ligada à física, matemática e computação quântica. Entretanto, ele percebeu rapidamente que os desafios mais urgentes estavam concentrados na comunicação entre equipamentos instalados em gigantescas estruturas computacionais. Durante a entrevista, o pesquisador explicou que o crescimento acelerado da inteligência artificial obrigou empresas do setor a construírem enormes agrupamentos de processadores gráficos capazes de trocar informações continuamente. Segundo ele, o principal desafio deixou de ser apenas criar chips rápidos e passou a ser garantir que todos os dispositivos consigam trabalhar juntos de maneira eficiente.

Ademais, Steinbrecher explicou que basta um único equipamento apresentar lentidão para comprometer o desempenho de milhares de outros dispositivos conectados simultaneamente. Isso acontece porque os sistemas de treinamento funcionam em sincronia absoluta. Enquanto uma GPU executa cálculos, todas as demais aguardam o término daquela etapa para continuar o processamento seguinte. Consequentemente, pequenos atrasos provocam desperdícios gigantescos de energia, processamento e tempo. Para os engenheiros da OpenAI, resolver esse gargalo tornou-se prioridade estratégica dentro da corrida global pela evolução da inteligência artificial.

Enquanto isso, Mark Handley ressaltou que as arquiteturas tradicionais de comunicação digital já não conseguem atender adequadamente às demandas atuais. Segundo o pesquisador, a internet clássica foi desenvolvida para milhões de usuários realizando tarefas independentes, o que permitia distribuir naturalmente o fluxo de dados. No treinamento de modelos avançados, porém, todos os equipamentos precisam atuar de maneira sincronizada e extremamente rápida. Dessa forma, pequenas falhas geram impactos enormes. O episódio revelou que alguns supercomputadores modernos possuem milhões de conexões ópticas e milhares de switches funcionando dentro de um único prédio, transformando a engenharia de redes em um dos pilares fundamentais da inteligência artificial contemporânea. A Microsoft também vem desenvolvendo redes de baixa latência capazes de conectar grandes estruturas computacionais em diferentes regiões para acelerar treinamentos de inteligência artificial em larga escala.

Como funciona o sistema MRC desenvolvido pela OpenAI

De acordo com Mark Handley, o MRC distribui informações por múltiplas rotas simultaneamente dentro da infraestrutura computacional. Essa estratégia reduz congestionamentos e melhora significativamente o equilíbrio do fluxo digital entre milhares de aceleradores gráficos. Em vez de depender de um único caminho para transportar informações, o sistema divide automaticamente os pacotes entre várias rotas disponíveis. Assim, a plataforma consegue evitar gargalos críticos que anteriormente prejudicavam o desempenho dos treinamentos inteligentes. Segundo os especialistas, esse modelo permite maior estabilidade operacional mesmo em ambientes extremamente complexos.

Além disso, a solução utiliza um recurso chamado “packet trimming”. Em vez de descartar completamente um pacote congestionado, o sistema preserva apenas o cabeçalho da transmissão e encaminha essa informação ao destino final. Dessa maneira, o equipamento receptor identifica imediatamente o problema e solicita uma retransmissão sem atrasos prolongados. Conforme os convidados explicaram no podcast, essa técnica elimina ambiguidades relacionadas à perda de dados e reduz drasticamente o tempo de recuperação das conexões. Consequentemente, os supercomputadores conseguem manter operações estáveis mesmo diante de falhas temporárias ou congestionamentos intensos.

Paralelamente, Greg Steinbrecher destacou que o principal diferencial da arquitetura está na capacidade de reagir automaticamente a falhas internas. Quando uma conexão apresenta defeito, o mecanismo encontra rapidamente trajetos alternativos sem interromper o treinamento das plataformas inteligentes. Antes da implementação dessa arquitetura, pequenos problemas eram suficientes para interromper operações gigantescas durante vários segundos. Atualmente, a própria malha computacional reorganiza o tráfego em poucos milissegundos. Segundo os engenheiros, essa mudança praticamente eliminou paralisações relacionadas à rede, permitindo que pesquisadores trabalhem sem precisar monitorar constantemente a infraestrutura tecnológica utilizada nos treinamentos.

Assista o programa

Parcerias internacionais e impactos para o futuro

O episódio também revelou a participação de grandes corporações no desenvolvimento dessa arquitetura digital. A Microsoft colaborou diretamente na construção dos centros de processamento utilizados pela OpenAI. Além disso, empresas como NVIDIA, AMD, Intel e Broadcom participaram da criação dos padrões técnicos relacionados ao MRC. Segundo os participantes do programa, o objetivo é criar uma solução aberta capaz de beneficiar toda a indústria global de inteligência artificial.

Igualmente, os convidados defenderam o compartilhamento tecnológico entre companhias do setor. Para Mark Handley, reinventar soluções isoladamente apenas desacelera a evolução da infraestrutura mundial de processamento inteligente. Conforme explicou o pesquisador, a própria internet evoluiu graças ao uso de padrões abertos como Ethernet. Portanto, a OpenAI acredita que disponibilizar o MRC publicamente poderá acelerar avanços em toda a cadeia tecnológica ligada à inteligência artificial. Dessa maneira, diferentes empresas poderão colaborar na criação de sistemas mais eficientes, baratos e confiáveis para o futuro.

Enquanto isso, Greg Steinbrecher afirmou que os limites físicos continuam sendo um enorme desafio para os supercomputadores modernos. Segundo ele, a velocidade da luz ainda representa uma barreira inevitável para conexões extremamente longas. Por essa razão, os grandes treinamentos continuarão concentrados em centros terrestres altamente integrados, e não em estruturas espaciais. Andrew Mayne encerrou a entrevista destacando que o objetivo da OpenAI é ampliar a quantidade de inteligência disponível no planeta. Conforme os participantes, aprimorar redes computacionais significa acelerar descobertas científicas, desenvolver plataformas mais sofisticadas e expandir o acesso global às ferramentas inteligentes.

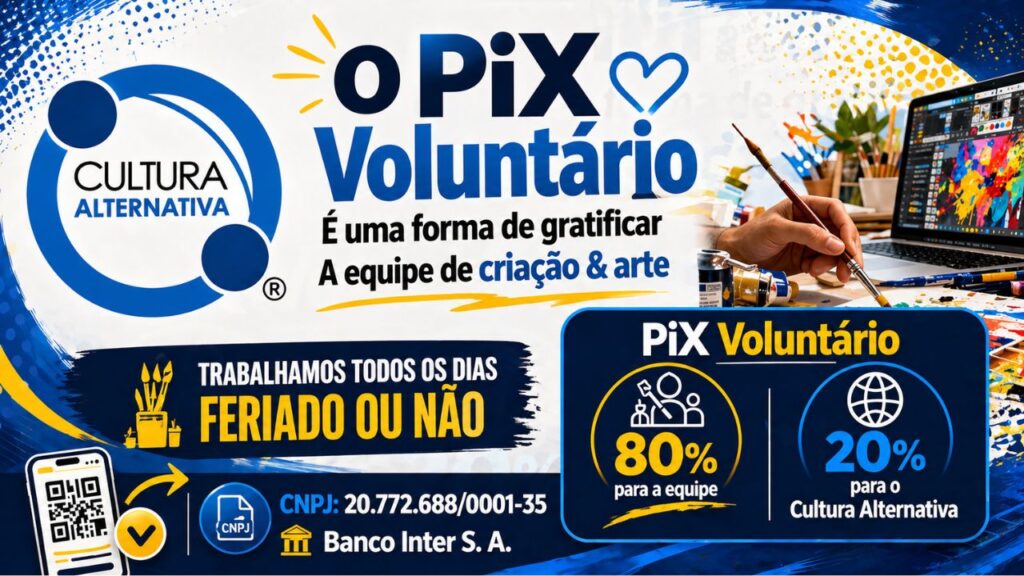

Cultura Alternativa Agradece

O Portal Cultura Alternativa agradece aos pesquisadores, engenheiros e profissionais envolvidos na construção das novas infraestruturas computacionais. Debates como o apresentado no OpenAI Podcast demonstram que o futuro das plataformas inteligentes depende tanto de algoritmos quanto da evolução das redes responsáveis por conectar milhões de componentes simultaneamente.

O Cultura Alternativa também agradece ao trabalho de sua equipe editorial e de criação, que acompanha diariamente as transformações tecnológicas mundiais para levar informação qualificada, acessível e independente aos leitores brasileiros. O assessor geral Fernando Araújo destacou a importância de ampliar o debate sobre inteligência artificial, infraestrutura digital e os impactos dessas tecnologias no cotidiano da sociedade contemporânea.

Anand Rao

Editor Chefe

Cultura Alternativa